BTC/HKD+0.12%

BTC/HKD+0.12% ETH/HKD+0.07%

ETH/HKD+0.07% LTC/HKD+0.43%

LTC/HKD+0.43% ADA/HKD+0.2%

ADA/HKD+0.2% SOL/HKD-0.17%

SOL/HKD-0.17% XRP/HKD+0.31%

XRP/HKD+0.31%編輯:LRS

注意力機制這么好用,怎么不把它塞到卷積網絡里?最近MetaAI的研究人員提出了一個基于注意力的池化層,僅僅把平均池化層替換掉,就能獲得+0.3%的性能提升!

VisualTransformer作為計算機視覺領域的新興霸主,已經在各個研究任務中逐漸替換掉了卷積神經網絡CNN。

ViT與CNN之間存在著許多不同點,例如ViT的輸入是imagepatch,而非像素;分類任務中,ViT是通過對類標記進行決策等等。

classtoken實際上是ViT論文原作者提出,用于整合模型輸入信息的token。classtoken與每個patch進行信息交互后,模型就能了解到具體的分類信息。

并且在自注意力機制中,最后一層中的softmax可以作為注意力圖,根據classtoken和不同patch之間的交互程度,就能夠了解哪些patch對最終分類結果有影響及具體程度,也增加了模型可解釋性。

但這種可解釋性目前仍然是很弱的,因為patch和最后一層的softmax之間還隔著很多層和很多個header,信息之間的不斷融合后,很難搞清楚最后一層softmax是否真的可以解釋分類。

Coinbits披露與其受Prime Trust的影響,承諾會為用戶追回資產:6月29日消息,比特幣投資APP Coinbits在推特上披露了其與加密托管機構Prime Trust的關系,Coinbits表示,仍有許多未知因素,但我們打算為那些在Prime Trust鎖定資金的會員而戰。內華達州監管機構的請愿書似乎表明Prime Trust仍然有足夠的比特幣來兌現我們會員的余額。我們正在代表我們的會員追回這些資產。目前Coinbits App的大部分功能都處于離線狀態,但我們正在開發新的解決方案,并打算盡快恢復我們的服務。

此前昨日消息,美國內華達州監管機構已申請接管Prime Trust。[2023/6/29 22:07:06]

所以如果ViT和CNN一樣有視覺屬性就好了!

最近MetaAI就提出了一個新模型,用attentionmap來增強卷積神經網絡,說簡單點,其實就是用了一個基于注意力的層來取代常用的平均池化層。

TRC20-USDT發行量突破461億枚,創歷史新高:據官方消息,TRC20-USDT發行量突破461億枚,創歷史新高。TRC20-USDT持有賬戶數已超過2476萬。

TRC20-USDT是Tether公司基于波場TRON網絡發行的錨定美元的穩定幣,轉賬速度快、低手續費的特點已經吸引了大批用戶,且已經有Binance、Huobi、OKX、Bitfinex、MEXC、KuCoin、Gate.io、Poloniex等多家交易所的支持。基于TRC20版本的USDT將大幅提升波場TRON現有的去中心化應用生態系統,帶來更高的整體價值存儲和更強的去中心化交易所流動性,并為企業級合作伙伴與機構投資者提供更便捷的區塊鏈入口。[2023/5/9 14:51:39]

仔細一想,池化層和attention好像確實很配啊,都是對輸入信息的加權平均進行整合。加入了注意力機制以后的池化層,可以明確地顯示出不同patch所占的權重。

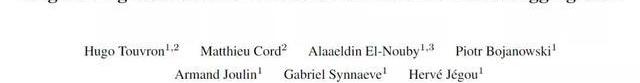

并且與經典ViT相比,每個patch都會獲得一個單一的權重,無需考慮多層和多頭的影響,這樣就可以用一個簡單的方法達到對注意力可視化的目的了。

資管巨頭VanEck高管:預計2023年金融機構將250億美元鏈下資產代幣化:12月8日消息,資管巨頭VanEck數字資產研究主管Matthew Sigel近日表示,預計明年金融機構將把超過250億美元的鏈下資產代幣化到區塊鏈上,以簡化托管和結算,同時降低客戶的成本。據ETF.com數據,VanEck在美國交易的68只ETF總資產約為520億美元,其中三只基金提供了對加密資產的敞口。(blockworks)[2022/12/8 21:30:16]

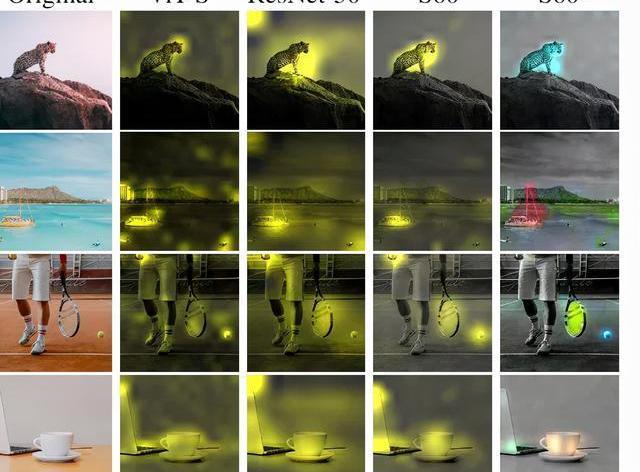

在分類任務中更神奇,如果對每個類別使用不同顏色進行單獨標記的話,就會發現分類任務也能識別出圖片中的不同物體。

基于Attention的池化層

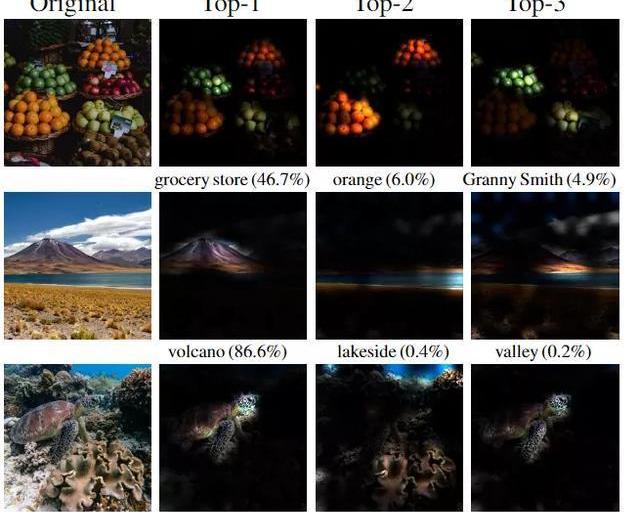

文章中新提出的模型叫做PatchConvNet,核心組件就是可學習的、基于attention的池化層。

中娛協正在研究成立元宇宙應用分會:11月8日消息,中國文化娛樂行業協會元宇宙應用行業交流會近日以視頻會議方式在京召開。中娛協會長劉金華表示,元宇宙應用作為新興行業,已成為數字經濟產業發展的重要方向。中娛協正在研究成立元宇宙應用分會,在政府的支持下和引導下,有效開展各項工作。協會也將進一步加快建立健全的行業自律工作機制,推動行業標準化建設,促進元宇宙應用行業高質量發展。[2022/11/8 12:33:03]

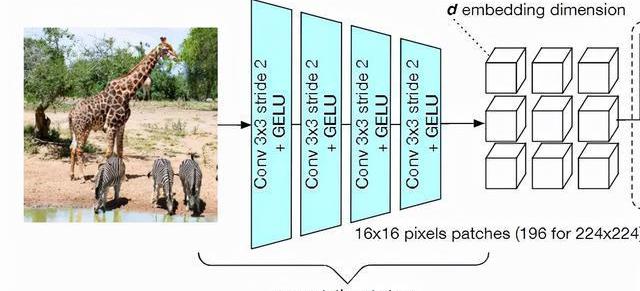

模型架構的主干是一個卷積網絡,相當于是一個輕量級的預處理操作,它的作用就是把圖像像素進行分割,并映射為一組向量,和ViT中patchextraction操作對應。

最近也有研究表明,采用卷積的預處理能讓模型的性能更加穩定。

比特幣全網未確認交易數量為18748筆:金色財經報道,BTC.com數據顯示,目前比特幣全網未確認交易數量為18,748筆,全網算力為233.12 EH/s,24小時交易速率為3.04交易/s,目前全網難度為32.05 T,預測下次難度上調0.85%至32.32 T,距離調整還剩11天2小時。[2022/9/17 7:02:30]

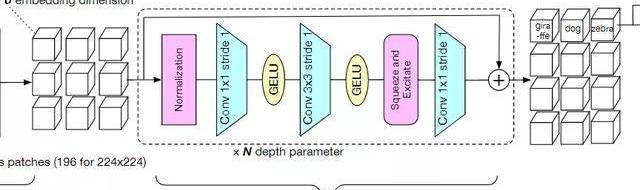

模型的第二部分column,包含了整個模型中的大部分層、參數和計算量,它由N個堆疊的殘差卷積塊組成。每個塊由一個歸一化、1*1卷積,3*3卷積用來做空間處理,一個squeeze-and-excitation層用于混合通道特征,最后在殘差連接前加入一個1*1的卷積。

研究人員對模型塊的選擇也提出了一些建議,例如在batchsize夠大的情況下,BatchNorm往往效果比LayerNorm更好。但訓練大模型或者高分辨率的圖像輸入時,由于batchsize更小,所以BatchNorm在這種情況下就不太實用了。

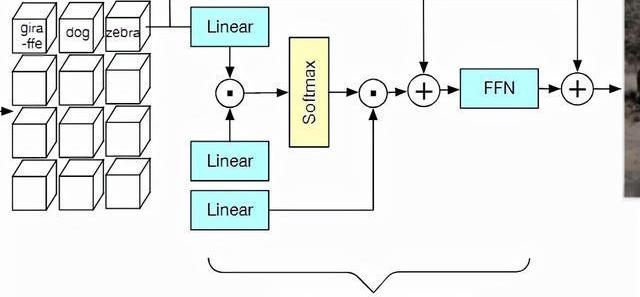

下一個模塊就是基于注意力的池化層了。

在主干模型的輸出端,預處理后的向量通過類似Transformer的交叉注意力層的方式進行融合。

注意力層中的每個權重值取決于預測patch與可訓練向量之間的相似度,結果和經典ViT中的classtoken類似。

然后將產生的d維向量添加到CLS向量中,并經過一個前饋網絡處理。

與之前提出的class-attentiondecoder不同之處在于,研究人員僅僅只用一個block和一個head,大幅度簡化了計算量,也能夠避免多個block和head之間互相影響,從而導致注意力權重失真。

因此,classtoken和預處理patch之間的通信只發生在一個softmax中,直接反映了池化操作者如何對每個patch進行加權。

也可以通過將CLS向量替換為k×d矩陣來對每個類別的attentionmap進行歸一化處理,這樣就可以看出每個塊和每個類別之間的關聯程度。

但這種設計也會增加內存的峰值使用量,并且會使網絡的優化更加復雜。通常只在微調優化的階段以一個小的學習率和小batchsize來規避這類問題。

實驗結果

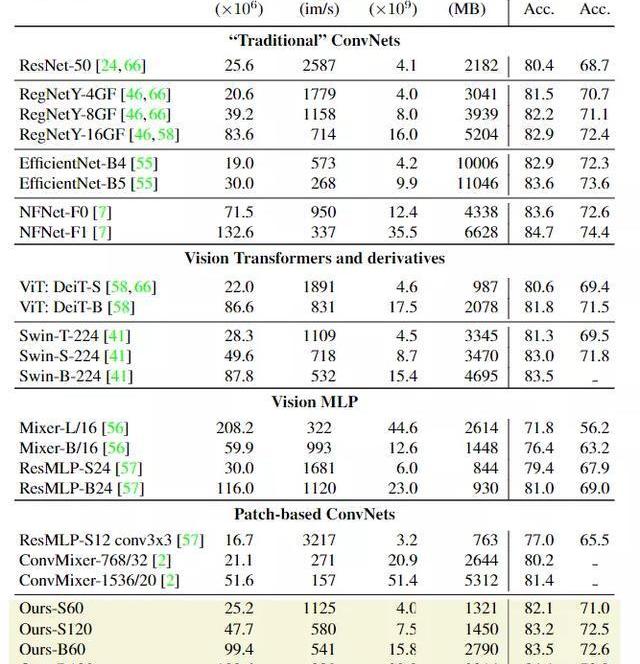

在圖像分類任務上,研究人員首先將模型與ImageNet1k和ImageNet-v2上的其他模型從參數量,FLOPS,峰值內存用量和256張圖像batchsize下的模型推理吞吐量上進行對比。

實驗結果肯定是好的,可以看到PatchConvNet的簡單柱狀結構相比其他模型更加簡便和易于擴展。對于高分辨率圖像來說,不同模型可能會針對FLOPs和準確率進行不同的平衡,更大的模型肯定會取得更高的準確率,相應的吞吐量就會低一些。

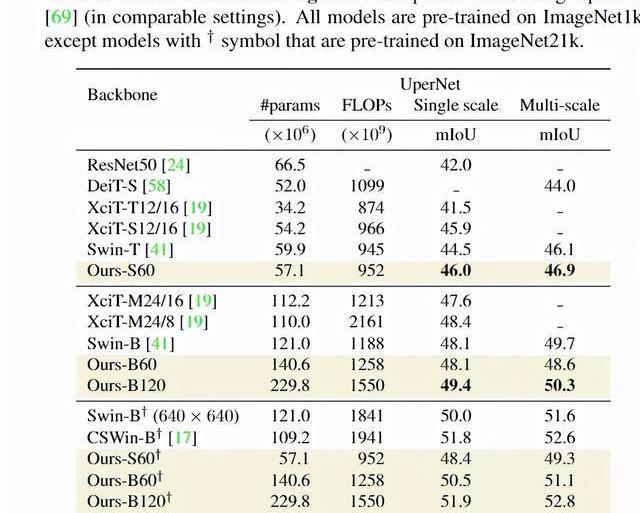

在語義分割任務上,研究人員通過ADE20k數據集上的語義分割實驗來評估模型,數據集中包括2萬張訓練圖像和5千張驗證圖像,標簽超過150個類別。由于PatchConvNet模型不是金字塔式的,所以模型只是用模型的最后一層輸出和UpperNet的多層次網絡輸出,能夠簡化模型參數。研究結果顯示,雖然PatchConvNet的結構更簡單,但與最先進的Swin架構性能仍處于同一水平,并且在FLOPs-MIoU權衡方面優于XCiT。

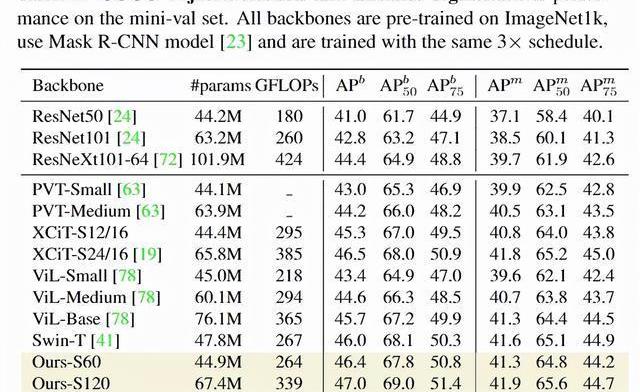

在檢測和實例分割上,研究人員在COCO數據集上對模型進行評估,實驗結果顯示PatchConvNet相比其他sota架構來說,能夠在FLOPs和AP之間進行很好的權衡。

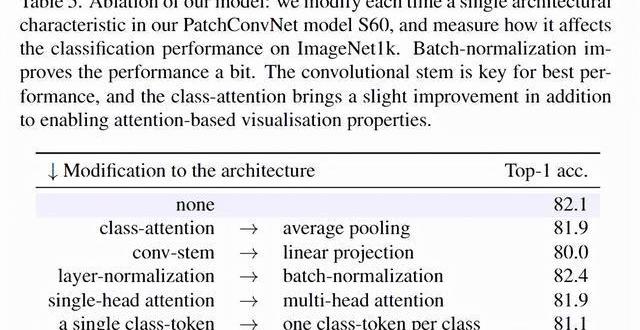

在消融實驗中,為了驗證架構問題,研究人員使用不同的架構對比了Transformer中的classattention和卷積神經網絡的平均池化操作,還對比了卷積主干和線性投影之間的性能差別等等。實驗結果可以看到卷積主干是模型取得最佳性能的關鍵,class-attention幾乎沒有帶來額外的性能提升。

另一個重要的消融實驗時attention-basedpooling和ConvNets之間的對比,研究人員驚奇地發現可學習的聚合函數甚至可以提高一個ResNet魔改后模型的性能。

通過把attention添加到ResNet50中,直接在Imagenet1k上獲得了80.1%的最高準確率,比使用平均池化層的baseline模型提高了+0.3%的性能,并且attention-based只稍微增加了模型的FLOPs數量,從4.1B提升到4.6B。

參考資料:

https://arxiv.org/abs/2112.13692

文/克莉斯汀 最近很多人都在說“元宇宙”。清華大學新媒體研究中心近期發布的《2020-2021元宇宙發展研究報告》認為,2020年是人類社會虛擬化的臨界點,而2021年已成為“元宇宙元年”.

1900/1/1 0:00:001月11日消息,日前,在CCTV2《正點財經》節目中,聚焦數字人民幣App(試點版)正式上線,并對京東科技在數字人民幣試點中的“供應鏈+場景+技術”服務優勢進行了報道.

1900/1/1 0:00:002021年4月,在一年一度的華為分析師大會上,華為輪值董事長徐直軍感慨:“今年的目標還是活下來,爭取活得好一點點.

1900/1/1 0:00:00摘要:現代汽車周一在東京的一次簡報中表示,公司將于今年開始在日本銷售Ioniq5電動車和燃料電池車Nexo;特斯拉部分車輛被曝減配,特斯拉中國官方客服表示.

1900/1/1 0:00:00來源:央視財經 土耳其貨幣里拉近年來持續貶值,今年以來,貶值幅度達到約45%。隨著里拉大幅貶值,土耳其的商品價格對于外國人來說越來越有吸引力。土耳其西部邊境城市埃迪爾內與保加利亞接壤.

1900/1/1 0:00:00過去一周,A股走勢分化。上證指數實現虎年“開門紅”,連漲4天后周五最高沖至3500.15點,全周漲3%.

1900/1/1 0:00:00